ChatGPT 和 Google 的 Gemini 已成為大型語言模型競爭中的領先力量。顯然,這些平台已改變了 AI 產業。然而,它們如何獲取資訊並管理數據集,一直是持續的倫理問題。

BeInCrypto 與 Web3 中的新興 AI 項目進行了對話,包括 ChainGPT、Space ID、Sapien.io、Vanar Chain、O.XYZ、AR.IO 和 Kindred,討論了當代關於知識產權、版權和所有權的擔憂。一個關鍵結論是,去中心化人工智慧(deAI)作為一個有價值的替代方案,具有巨大潛力。

自創建以來,大型語言模型(LLMs)迅速獲得了廣泛應用。從許多方面來看,像 OpenAI 的 ChatGPT 和 Google 的 Gemini 這樣的平台,是公眾首次真正接觸到人工智慧(AI)能力及其無窮潛力的機會。

然而,這些公司也因其運作方式受到審查。為了保持競爭力,AI 模型需要訪問大量數據集。LLMs 只有通過處理海量文本,才能生成類似人類的回應並理解複雜的查詢。

為實現這一點,OpenAI、Google、Meta、Microsoft、Anthropic 和 Nvidia 等領先科技巨頭,基本上將網路上所有可用的數據和資訊匯集起來,用於訓練其 AI 模型。這種做法引發了嚴重的問題:這些平台輸入並隨後以輸出形式呈現的內容,究竟屬於誰?

儘管 AI 具有顛覆性潛力,但知識產權的擔憂已演變成高度爭議的法律戰。

AI 的快速採用引發了關於數據所有權、隱私和潛在版權侵權的擔憂。一個關鍵爭議點是,使用受版權保護的材料來訓練由大型企業獨家控制的集中式 AI 模型。

Vanar Chain 執行長 Jawad Ashraf 向 BeInCrypto 表示:「AI 公司正在未經許可或分享成果的情況下,利用創作者的努力建立帝國。作家、藝術家和音樂家花費多年時間完善他們的技藝,卻發現他們的作品被 AI 模型吸收,並在幾秒鐘內生成仿製品。」

這一問題確實引發了廣泛的不滿。Vanar Chain 執行長補充道,OpenAI 和其他公司已公開承認抓取受版權保護的材料,這引發了訴訟,並促使人們更廣泛地反思數據倫理。

Ashraf 表示:「問題的核心在於補償——AI 公司認為抓取公開數據是公平的,而創作者則視其為明目張膽的搶劫。」

AI 生成工作的邊界定義

《紐約時報》於 2023 年 12 月對 OpenAI 和微軟提起訴訟,指控其侵犯版權並未經授權使用其知識產權。

《紐約時報》指控微軟和 OpenAI 建立了一種基於「非法複製和使用《紐約時報》獨特且有價值的作品」的商業模式。該報還指出,這些模型「利用並在許多情況下保留了這些作品中大量受版權保護的內容」。

四個月後,來自美國六個州的八家新聞出版商也因版權侵權問題對微軟和 OpenAI 提起訴訟。

《芝加哥論壇報》、《丹佛郵報》、加州的《水星報》、《紐約每日新聞》、加州的《橙縣紀事報》、《奧蘭多哨兵報》、明尼蘇達州的《先鋒報》以及佛羅里達州的《太陽哨兵報》均指控這兩家科技公司未經授權在其 AI 產品中使用其文章,並錯誤歸因不準確的資訊。

Sapien.io 聯合創始人 Trevor Koverko 向 BeInCrypto 表示:「法院現在被迫回答幾年前還不存在的問題:AI 生成的內容是否構成衍生作品?版權持有者在其數據未經同意被使用時,能否要求賠償?」

除了新聞機構外,出版商、作家、音樂家和其他內容創作者也因版權問題對這些科技公司提起法律訴訟。

跨產業法律戰火

就在上週,三個行業組織宣布將在巴黎法院起訴 Meta,指控 Meta「未經授權大量使用受版權保護的作品」來訓練其生成式 AI 聊天機器人助手,這些助手用於 Facebook、Instagram 和 WhatsApp。

與此同時,視覺藝術家 Sarah Andersen、Kelly McKernan 和 Karla Ortiz 對 AI 藝術生成器 Stability AI、DeviantArt 和 Midjourney 提起訴訟,指控其使用她們的作品來訓練 AI 模型。

AR.IO 創始人 Phil Mataras 表示:「當涉及到中心化 AI 公司未經監管的數據和創意材料使用時,擔憂是無止境的。目前,任何擁有公開作品的藝術家、作家或音樂家都可能被 AI 算法爬取其作品,這些算法學會創造幾乎相同的內容——並從中獲利,而藝術家卻一無所獲。」

OpenAI 和 Google 特別強調,如果立法限制他們使用受版權保護的材料,美國將在 AI 競賽中輸給中國。根據他們的說法,中國企業在較少的監管限制下運作,這讓他們的競爭對手擁有關鍵優勢。

這些科技巨頭正積極遊說美國政府,將 AI 使用受版權保護的數據進行訓練歸類為「合理使用」。他們主張,AI 處理受版權保護的內容後,產生的輸出與原始材料有根本上的不同。

然而,隨著生成式 AI 工具越來越多地產出文字、圖像和聲音,許多行業正對這些公司提起法律訴訟。

O.XYZ 創辦人兼執行長 Ahmad Shadid 表示:「內容創作者——無論是作家、音樂家還是軟體開發者——經常表示他們的智慧財產權被以超出合理使用範圍的方式利用,尤其是當 AI 系統複製或重現他們原創作品的某些部分時。」

與此同時,在 Web3 領域,參與者正在遊說,希望找到一種替代傳統企業開發大型語言模型(LLM)的方法。

去中心化 AI(deAI)是 Web3 中的一個新興領域,它探索利用區塊鏈和分散式帳本技術來創建更民主和透明的 AI 系統。

Kindred 的執行長兼創辦人 Max Giammario 解釋道:「deAI 利用區塊鏈和分散式帳本技術,旨在解決數據所有權和版權問題,通過創建更透明的 AI 系統。它將 AI 模型的開發和控制分散到全球網絡中,建立更公平的 AI 訓練模型,尊重內容創作者的權利。deAI 還旨在為創作者提供公平的補償機制,這些創作者的作品被用於 AI 訓練,這可能解決許多與中心化 AI 模型相關的問題。」

隨著 AI 在全球的重要性日益增加,其與區塊鏈的結合有望改變這兩個領域,為加密貨幣創新和投資開闢新的途徑。

作為回應,業界的開發者已經開始開發成功結合 AI 和 Web3 技術的項目。

與生產中心化 AI 模型的企業不同,deAI 的目標是完全開源。

OpenAI 先前曾主張,儘管使用受版權保護的材料來訓練其 AI 模型,但其行為符合美國的合理使用原則。此外,其最受歡迎的應用程式 ChatGPT 完全免費使用。

Space ID 的業務發展總監 Harrison Seletsky 指出了 OpenAI 論點中的矛盾之處。

「明顯的道德問題在於,這些材料未經創作者的明確許可就被使用。如果它們受版權保護,則必須獲得許可,並且通常需要支付費用。但除此之外,即使像 ChatGPT 這樣的大型語言模型使用開源數據,OpenAI 的模型也並非開源。它們利用了公開可用的材料,卻沒有完全『回饋』給這些來源。

這裡還有一個更廣泛的問題:AI 是否應該開源?OpenAI 的 ChatGPT 並非開源,而像中國的 DeepSeek 這樣的模型則是開源的,去中心化 AI 也是如此。從道德和知識產權的角度來看,後者無疑是更好的選擇。」Seletsky 表示。

這些科技巨頭的集中控制也引發了關於 AI 模型實施和監管的其他擔憂。

與去中心化 AI 的社區驅動性質相反,集中式 AI 模型由少數人建立,這可能導致偏見。

「集中式 AI 通常由單一企業運營,決策由自上而下的利潤動機驅動。它本質上是一個由單一實體擁有和管理的黑箱。相比之下,去中心化 AI 依賴於社區驅動的方法。AI 被設計為分析社區反饋,並優化集體利益,而不僅僅是企業利益。」O.XYZ 創始人兼 CEO Ahmad Shadid 解釋道。

與此同時,區塊鏈技術 為貨幣化提供了一條清晰的路徑。

「創作者可以將其創意資產——如文章、音樂甚至想法——代幣化,並自行定價。這為知識產權的創作者和使用者創造了一個更公平的環境,本質上形成了一個知識產權的自由市場。區塊鏈上的所有內容都是透明且不可篡改的,這使得證明所有權變得更加容易,也讓他人更難在未對齊激勵的情況下利用他人的作品。」Seletsky 告訴 BeInCrypto。

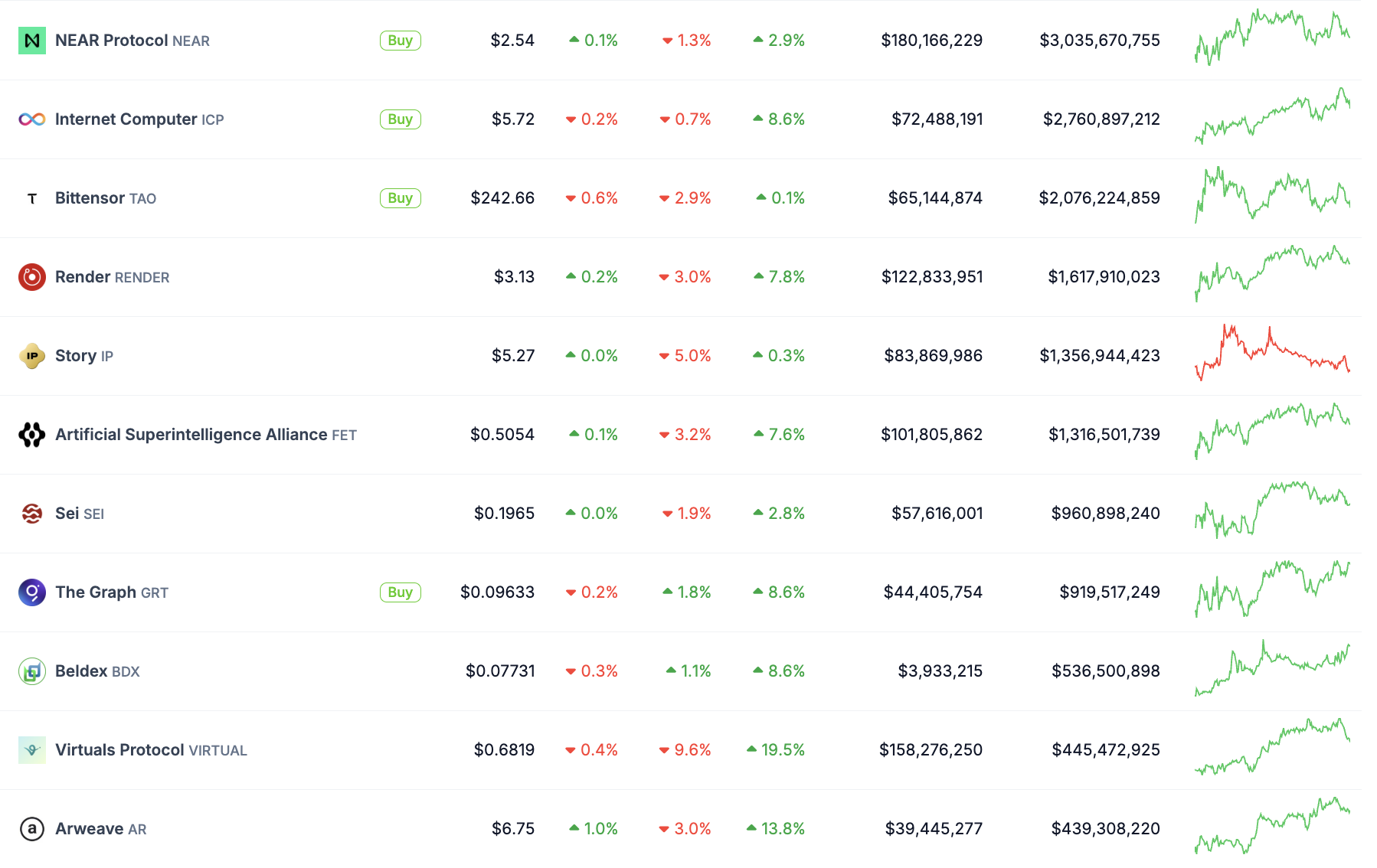

不同的 Web3 開發者已經開發出去中心化生成式 AI 內容的項目。像 Story、Inflectiv 和 Arweave 這樣的平台利用區塊鏈技術的各個方面,確保用於 AI 模型的數據集是經過道德審查的。

ChainGPT 創始人 Ilan Rakhmanov 將去中心化 AI 視為對抗集中式 AI 的重要力量。他認為,解決現有 AI 壟斷的不道德行為,對於未來培育一個更健康的行業至關重要。

拉赫曼諾夫(Rakhmanov)表示:「這開創了一個危險的先例,讓 AI 公司可以自由使用受版權保護的內容,卻無需適當的歸屬或支付。從法律角度來看,這將引發監管審查;從道德層面而言,這剝奪了創作者的控制權。ChainGPT 相信鏈上歸屬與變現機制,確保 AI 使用者、貢獻者與模型訓練者之間能進行公平的價值交換。」

然而,若要讓去中心化人工智慧(DeAI)站上舞台中心,首先必須克服多項障礙。

儘管DeAI 具有蓬勃發展的潛力,但它仍處於初期階段。在這方面,像 OpenAI 和 Google 這樣的公司在經濟實力與基礎設施上佔有優勢。它們擁有處理大量數據所需的龐大資源。

科維爾科(Koverko)告訴 BeInCrypto:「中心化的 AI 公司擁有龐大的計算能力,而 DeAI 則需要高效、分散的網絡來擴展規模。此外,數據也是一大挑戰——中心化模型依賴於囤積的數據集,而 DeAI 必須建立可靠的管道,以公平地獲取、驗證並補償貢獻者。」

對此,艾哈邁德·沙迪德(Ahmad Shadid)補充道:

「在分散式帳本上建立並運行 AI 系統可能相當複雜,尤其是在試圖大規模處理大量數據時。此外,還需要謹慎監督,以確保 AI 的學習過程與社區道德和目標保持一致。」

這些科技巨頭還可以利用其資源與人脈,強力遊說反對像 DeAI 這樣的競爭對手。

賈馬里奧(Giammario)表示:「他們可能會通過倡導有利於中心化模型的法規、利用市場主導地位限制競爭,或控制 AI 開發所需的關鍵資源來達成目的。」

對於阿什拉夫(Ashraf)來說,這種情況發生的可能性應該被視為理所當然。

Vanar Chain 執行長賈瓦德·阿什拉夫(Jawad Ashraf)預測:「當你的整個商業模式建立在囤積數據並秘密變現的基礎上時,你最不希望看到的就是一個開放、透明的替代方案。預計 AI 巨頭將遊說反對 DeAI,推動限制性法規,並利用其龐大資源來抹黑去中心化的替代方案。但互聯網本身最初也是一個去中心化的系統,後來才被企業接管,而人們正逐漸意識到中心化控制的弊端。開放式 AI 的戰鬥才剛剛開始。」

然而,為了進一步推動其使命,DeAI 需要提升公眾意識,觸及 Web3 用戶以及圈外人士。

知識鴻溝的橋樑

當被問及去中心化人工智慧(deAI)目前面臨的主要障礙時,Space ID 的 Seletsky 表示,人們需要意識到 AI 模型中的版權侵權問題,才能解決它。

他表示:「主要障礙是缺乏教育。大多數用戶不知道數據從何而來、如何被分析,以及誰在控制它。許多人甚至沒有意識到 AI 和人類一樣存在偏見。在理解去中心化 AI 模型的優勢之前,需要先教育普通人這些知識。」

一旦公眾理解了中心化 AI 模型中的版權問題,deAI 的支持者就必須積極展示 deAI 作為強力替代方案的優勢。然而,儘管意識有所提高,deAI 仍然面臨採用挑戰。

Koverko 表示:「採用是另一個挑戰。企業習慣於使用現成的 AI 解決方案,而 deAI 需要在匹配這種易用性的同時,證明其在安全性、透明度和創新方面的優勢。」

在解決教育和易用性挑戰後,deAI 更廣泛採用的關鍵在於建立監管清晰度和公眾信任。Sapien.io 的聯合創始人 Trevor Koverko 也補充道,deAI 需要伴隨監管清晰度才能實現這些目標。

他強調:「如果沒有明確的框架,deAI 項目可能會因法律不確定性而被邊緣化,而中心化參與者則會推動有利於其主導地位的政策。克服這些挑戰意味著改進技術、證明實際價值,並建立一個推動開放、民主化 AI 的運動。」

Shadid 同意需要更多機構支持,並補充說這應該與建立更大的公眾信任相結合。

Ahmad Shadid 解釋道:「如果你花費數十年完善專有方法,透明度可能會令人不安,因此 deAI 必須在信任和創新方面證明其優越性。另一個障礙是建立足夠的用戶信任和監管清晰度,讓人們甚至政府對數據處理方式感到放心。獲得關注的最佳方式是展示去中心化 AI 在實際應用中明顯優於中心化 AI 的案例,或者至少證明它在速度、成本和質量上能與之匹敵,同時更加開放和公平。」

最終,圍繞 AI 模型的版權問題呼籲一種範式轉變,重點在於尊重知識產權並促進更民主的 AI 生態系統——無論 deAI 的最終影響如何。