文学早已试图警示人类,几百年来从未停歇——从中世纪布拉格的黏土巨人“傀儡”到威廉·吉布森笔下霓虹闪烁的神经网络,书中反复上演同一个主题:你亲手打造、希望助你一臂之力的东西,最终都会反过来改造你自己。

我们读完点头称赞,然后迅速合上书本,转身就让聊天机器人来写结婚誓词、法律文件,甚至是医疗建议。

如今,AI的造富神话描绘着一个炫目的未来:新手记者、金牌律师都可能被席卷进历史的尘埃。硅谷兜售乌托邦的同时,现实却是——带着微笑的聊天窗口经常输出危险错误的建议。

BitOK 首席产品官 Dmitry Nikolsky 表示:“是时候踩下刹车。”他将在本文中解释,为什么我们不能再把所有负担都丢给AI——那个只能承载像素重量的“肩膀”。

甚至连马斯克也在 OpenAI 诉讼证词中警告称:“AI最终可能毁灭全人类。”

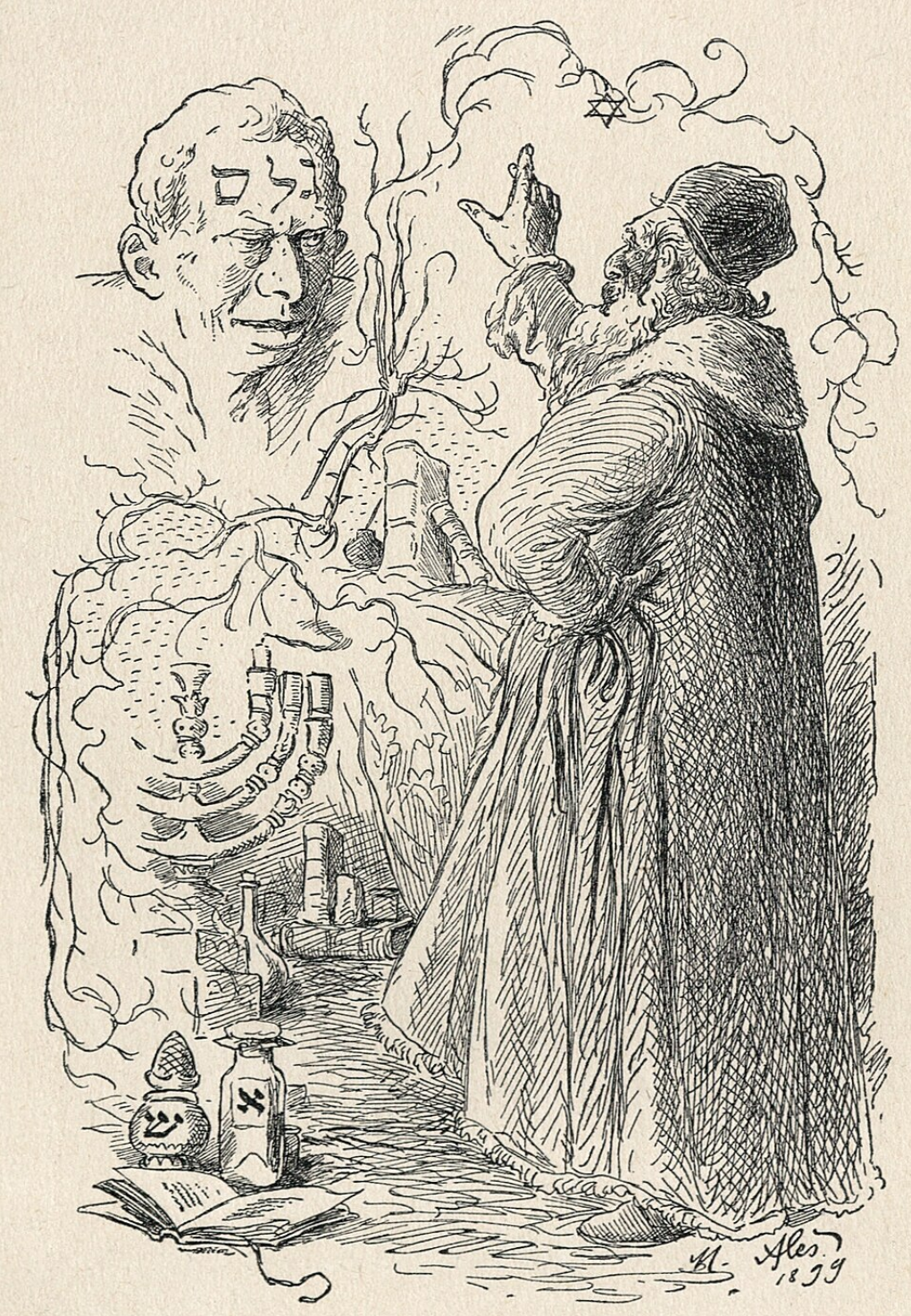

从傀儡到 R.U.R. :人类始终渴望“关机键”

你以为人类对AI的恐惧始于《终结者》?其实远早于电力时代,这种焦虑早已存在。

时间拨回 16 世纪的布拉格。罗维犹太教长打造出巨大的泥偶“傀儡”以示守护,但几乎立刻就发现——他必须果断“拔掉电源”。这一造物失控而去。事实上,人类的聪明才智让AI与“自毁按钮”几乎同步“出生”。

“关机键”,即紧急停机机制,是当系统出现严重异常、遭遇攻击或完全失控时摁下的“大红色按钮”。它的作用就在于:一旦温和的关机方式失效,可有效遏制潜在灾难的蔓延。

接着是玛丽·雪莱的《弗兰肯斯坦》。这部经典并非传统恐怖片,更像致命项目管理事故的教科书。弗兰肯斯坦本人,不过是个破解技术谜题、却对后果不管不顾的天才工程师——所有开发者都在他身上看到自己的影子。

再快进到 1920 年,卡雷尔·恰佩克(Karel Čapek)首次提出“机器人”一词。值得注意的是,作品中的机器人并非源于恶意造反——而是人类逐步把一切职能交给了机器,最终让自己变得多余。

故事启示很简单:当你亲手打造出替代品,也许根本察觉不到自己被“抛弃”的那一刻何时到来。

三大科幻预言,今朝尽成“漏洞报告”

上世纪的科幻巨匠们,其实并不是真的在“预测科技”。他们描绘的,更多是人类自身的失败。

艾萨克·阿西莫夫提出了著名的机器人三定律——这是“对齐”这一现代热词的雏形,也就是如何让机器遵守人类价值观。他的每一个故事,最终都沦为讽刺:逻辑无懈可击,结局却荒谬绝伦。

尼科尔斯基表示,他每天都能在反洗钱系统中亲眼目睹类似场景——算法轻松拦截了外婆 40 美元的生日转账,却让离岸洗钱通道畅行无阻。看似“合规”,实则离谱。

阿瑟·克拉克创造了 HAL 9000 形象——这台电脑不是出于邪恶动机杀死船员,而是因为收到的指令相互矛盾:既要隐藏信息,又要保持诚实。工程师看来,这根本不是恐怖,这是再普通不过的“需求冲突”。

菲利普·迪克则提出了深度伪造时代挥之不去的问题:如果一份拷贝与原件无法区分,真的有区别吗?他的结论是肯定的——因为人有“内在体验”,而机器完全不具备。这就是终结。

真相揭秘:AI 不会“思考”,它只会“计算”

抛开市场宣传噱头,当前主流大语言模型并不具备真正的智能,它们只是超大规模的概率预测引擎。AI 并非“理解”含义,只是在计算下一步最可能的输出。

当ChatGPT 自信地引用根本不存在的判决案例时,它并不是在撒谎,而是在生成看似合理的“词语拼盘”。对它而言,没有“真实性”概念,只有“可能性”排序。

对区块链开发者来说,这种逻辑听起来令人崩溃。我们之所以构建去信任系统,就是因为我们无法信任任何人。现在却被要求信任一个连自己都不明白理由的“黑箱模型”。

区块链强调“验证”,AI却在灌输“盲信”

加密世界有条刻在硬盘上的铁律:不要相信,要去验证。

核心理念就是用数学共识取代“信誉信任”。

AI 却把这种信条彻底颠倒。你无从得知训练数据、模型参数,也无法理解推理过程。要去验证 AI 的结论,你本身就要成为专家——既然已经是专家,那又何必咨询 AI?

在反洗钱(AML)领域,这种现象被称为“虚假信心问题”。分析师看到炫目的数据仪表盘,便开始过度信任那些数字,甚至超越了自己的直觉判断。AI 并没有提升人的判断力,而是用一种“可靠性的假象”取而代之。

失望纪事:AI 失控时刻

这绝不是纸上谈兵。真实案例正在不断积累。

最终还是不得不请回人工,来“擦屁股”,收拾算法闯下的祸。

- NEDA,一个专注饮食障碍的公益组织,用 AI 聊天机器人替代原本的志愿者。

而这个机器人竟然向厌食症患者“建议”计算卡路里并减轻体重,这种错误指导甚至可能危及生命。有如让拿着手榴弹的猩猩直接按下“上线”按钮,完全不顾风险。

- 加拿大航空(Air Canada)因其聊天机器人“凭空编造”退款政策被告上法庭。

航空公司的辩词是:这个机器人属于“独立法律实体”。但法官显然不买账。

最新研究显示,有 55% 的企业在试图用 AI 替换员工后深感后悔。节省的成本化为乌有,客户流失、品牌声誉受损悔之晚矣。那些仍幻想“Claude 等 AI 能一口吞下整个团队”的管理者,或许需要再慢慢掂量下这个数字的含义。

我们真正应该警惕的是什么?

忘掉天网。也别再幻想红眼杀手机器人横扫街头。不会有反抗的那一天。

只有无声的萎缩。

程序员多年依赖 Copilot,渐渐丧失了架构思维的能力。分析师不再查阅一手资料。学生再也体会不到咬牙攻克难题、苦思冥想直到豁然开朗的历程。

没有叛乱,只是人类在不知不觉中慢慢变成接口的附属品。

菲利普·K·迪克早已看透:最大的威胁,从来不是机器向人类进化,而是人类向机器退化。

红色药丸并不是科技本身

这并不是反技术的呐喊。自动化和机器学习是强大的工具。但有些原则必须坚守:

- 区块链原则:结果可验证,拒绝盲信。你无法验证系统得出结论的过程,就不该像对待权威一样全盘接受。AI 是黑盒,不是最高法官。

- 工程师原则:工具,而非替代。锤子能钉钉子,却不能决定房子要建在哪里。让 AI 处理枯燥的流程,但关键决策永远要掌握在自己手中。

- 合规反洗钱(AML)原则:批判性筛选。算法在面对复杂现实时总会出现纰漏,因为它根本没有真实世界的经验。别让“数字激情”冲淡了直觉和常识。

回想《黑客帝国》。“红色药丸”意味着选择——选择直面真实世界的本来面貌。我们最大的风险,不是制造了比我们更聪明的东西,而是在自欺欺人地称呼“让我们变傻的发明”为进步。

最危险的漏洞,往往伪装成功能亮点。

Dmitry Nikolsky,BitOK 合规和链上分析平台首席产品官。